ระหว่างที่มหากาพย์ OpenAI ยังไม่จบลง ฝั่งคู่แข่ง Anthropic (ที่มีข่าวว่ามีข้อเสนอให้ควบรวมกัน) ก็เดินหน้าออกโมเดลเวอร์ชันใหม่ Claude 2.1

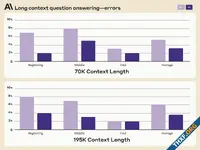

จุดเด่นของ Claude 2.1 คือการรองรับอินพุตความยาว 200,000 token หรือตีเป็นคำได้ 150,000 คำ เทียบได้กับหนังสือราว 500 หน้า การรองรับอินพุตที่ยาวขนาดนี้ทำให้ Claude สามารถอ่านเอกสารการเงินขนาดยาว, วรรณกรรมขนาดยาว หรืออ่านโค้ดทั้งหมดขององค์กรได้จบทีเดียว แล้วนำไปสรุป วิเคราะห์ ตอบคำถาม ฯลฯ ตามโจทย์ของแต่ละองค์กรได้สบายๆ (ตัวอย่างของ Anthropic คือเอาเอกสารงบประมาณของรัฐสภาสหรัฐ ย้อนหลัง 3 ปีใส่เข้าไปใน Claude แล้วให้สรุปแนวโน้มงบประมาณ)

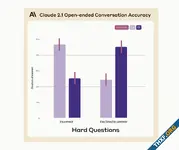

ในแง่ของคุณภาพ Claude 2.1 แก้ปัญหาเรื่องข้อมูลผิดลงไปได้มาก ตัวเลขของ Anthropic บอกว่าลดลง 2 เท่าเมื่อเทียบกับ Claude 2.0 และอัตราการตอบว่าไม่แน่ใจ (แทนการเลือกตอบผิดๆ มั่วๆ) นั้นเพิ่มขึ้นเช่นกัน

นอกจากตัวโมเดลเวอร์ชันใหม่แล้ว Anthropic ยังเพิ่ม API ให้นักพัฒนาภายนอกเข้ามาเชื่อมต่อกับ Claude ในงานเฉพาะด้านต่างๆ เช่น การคำนวณตัวเลขที่ซับซ้อน, การแปลภาษา, การค้นหาข้อมูลในฐานข้อมูลหรือค้นเว็บผ่าน API ด้วย

ตอนนี้ Claude 2.1 เริ่มนำมาใช้งานแล้วทั้งผ่าน API และการแชทผ่านหน้าเว็บ Claude.ai ทั้งผู้ใช้กลุ่มฟรีและเสียเงิน แต่ฟีเจอร์ 200K token ยังจำกัดเฉพาะผู้ใช้แบบเสียเงินเท่านั้น

ที่มา - Anthropic

Topics:

Anthropic

LLM

Artificial Intelligence

อ่านต่อ...

จุดเด่นของ Claude 2.1 คือการรองรับอินพุตความยาว 200,000 token หรือตีเป็นคำได้ 150,000 คำ เทียบได้กับหนังสือราว 500 หน้า การรองรับอินพุตที่ยาวขนาดนี้ทำให้ Claude สามารถอ่านเอกสารการเงินขนาดยาว, วรรณกรรมขนาดยาว หรืออ่านโค้ดทั้งหมดขององค์กรได้จบทีเดียว แล้วนำไปสรุป วิเคราะห์ ตอบคำถาม ฯลฯ ตามโจทย์ของแต่ละองค์กรได้สบายๆ (ตัวอย่างของ Anthropic คือเอาเอกสารงบประมาณของรัฐสภาสหรัฐ ย้อนหลัง 3 ปีใส่เข้าไปใน Claude แล้วให้สรุปแนวโน้มงบประมาณ)

ในแง่ของคุณภาพ Claude 2.1 แก้ปัญหาเรื่องข้อมูลผิดลงไปได้มาก ตัวเลขของ Anthropic บอกว่าลดลง 2 เท่าเมื่อเทียบกับ Claude 2.0 และอัตราการตอบว่าไม่แน่ใจ (แทนการเลือกตอบผิดๆ มั่วๆ) นั้นเพิ่มขึ้นเช่นกัน

นอกจากตัวโมเดลเวอร์ชันใหม่แล้ว Anthropic ยังเพิ่ม API ให้นักพัฒนาภายนอกเข้ามาเชื่อมต่อกับ Claude ในงานเฉพาะด้านต่างๆ เช่น การคำนวณตัวเลขที่ซับซ้อน, การแปลภาษา, การค้นหาข้อมูลในฐานข้อมูลหรือค้นเว็บผ่าน API ด้วย

ตอนนี้ Claude 2.1 เริ่มนำมาใช้งานแล้วทั้งผ่าน API และการแชทผ่านหน้าเว็บ Claude.ai ทั้งผู้ใช้กลุ่มฟรีและเสียเงิน แต่ฟีเจอร์ 200K token ยังจำกัดเฉพาะผู้ใช้แบบเสียเงินเท่านั้น

ที่มา - Anthropic

Topics:

Anthropic

LLM

Artificial Intelligence

อ่านต่อ...